Tu peux continuer à fabriquer tes Shorts à la main, scène par scène, comme si on était encore en atelier artisanal. Ou tu peux construire un pipeline vidéo IA automatisé avec n8n : une architecture qui prend une idée, génère le script, produit les scènes, assemble la voix off, stocke les assets et te livre une vidéo prête à publier sur TikTok, YouTube Shorts ou Instagram Reels.

Ce n’est pas magique. C’est une chaîne de production. Dans cet article, on démonte la machine proprement : rôle de n8n, structure du pipeline, stack utilisée, coûts réels, limites — sans bullshit, sans promesse de viralité.

Table des matières

- Qu’est-ce qu’un pipeline vidéo IA automatisé avec n8n ?

- Les 4 rôles du pipeline : qui fait quoi ?

- À quoi ressemble un run réel dans n8n ?

- La stack et ce que ça coûte vraiment

- Les fondations Airtable : paramétrer une fois, produire à l’infini

- Ce que le pipeline ne fait pas (à lire avant de commencer)

- Questions fréquentes

Qu’est-ce qu’un pipeline vidéo IA automatisé avec n8n ?

Un pipeline vidéo IA est un workflow automatisé qui enchaîne plusieurs étapes sans intervention manuelle sur les tâches de production :

- Extraction du contexte — lecture de ta marque, ton audience, tes contraintes depuis Airtable

- Scénarisation — structuration en scènes et génération des prompts via un LLM (OpenRouter)

- Génération des médias — visuels et voix off via les modèles IA de ton choix (Kling, Grok, Sora, Véo + ElevenLabs)

- Assemblage et livraison — montage des scènes, fusion voix/vidéo, stockage Cloudinary, email de livraison

L’outil qui orchestre tout ça : n8n, une plateforme d’automatisation open-source que tu héberges sur ton propre serveur. C’est lui qui enchaîne les appels, gère les erreurs, fait circuler les données entre chaque brique — et s’assure que chaque vidéo suit exactement les mêmes étapes, dans le bon ordre, à chaque fois.

La différence avec “utiliser un outil SaaS de vidéo IA” : tu n’es pas client d’une interface fermée. Tu es architecte d’une infrastructure qui t’appartient, que tu peux étendre, connecter et faire tourner 24h/24 sans te connecter à quoi que ce soit.

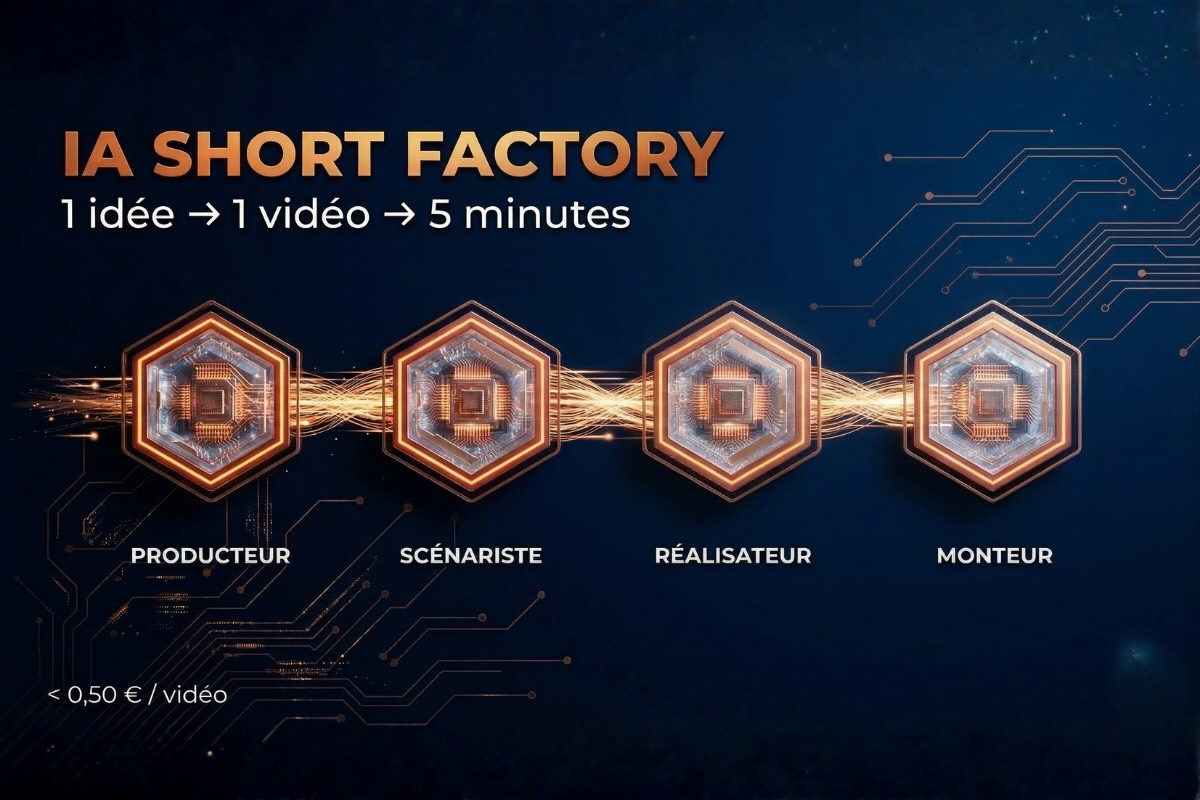

Les 4 rôles du pipeline : qui fait quoi ?

Le pipeline IA Short Factory repose sur 4 workflows n8n distincts. Chacun a une responsabilité précise et passe le relais au suivant.

Le Producteur — il reçoit et enrichit la commande

Entrée : un clic sur “Génère une vidéo” dans Airtable, lié à une idée de contenu.

Action : récupère l’ensemble du contexte — marque, audience cible, charte graphique, durée souhaitée, format. Enrichit la demande et construit un brief structuré.

Sortie : un “gizone global” transmis au Scénariste.

C’est lui qui fait le pont entre ta base de données et le cerveau du système. Sans lui, le reste du pipeline ne sait pas pour qui ni pourquoi il produit.

Le Scénariste — il structure la vidéo

Entrée : le brief du Producteur + le modèle IA cible.

Action : génère la structure narrative complète. Il choisit parmi plusieurs schémas intégrés — PAISA (Problème, Agitation, Intensification, Solution, Action), AIDA, RIVEAL (révélation progressive, utilisé sur les contenus mystère/historique), Impact — en fonction du type de contenu et de l’audience. Il découpe en scènes, calcule le poids de chaque séquence (ex. : le problème = 25 % de la durée), rédige les prompts visuels et audio pour chaque scène.

Sortie : un JSON structuré avec les prompts de génération pour chaque scène.

Le Scénariste est calibré selon le modèle réalisateur choisi : Grok travaille en scènes de 6 secondes, Sora en 10-15 secondes — les prompts s’adaptent automatiquement.

Le Réalisateur — il génère les médias

Entrée : le JSON de scènes du Scénariste.

Action : génère les visuels scène par scène via le modèle IA sélectionné (Grok, Kling, Sora ou Véo). Génère les voix off via ElevenLabs (sauf Sora/Véo qui intègrent leur propre voix). Stocke chaque fichier — vidéo, image, audio — automatiquement sur Cloudinary, avec un nommage structuré.

La technique du “Last Frame Conditioning” : pour assurer la continuité visuelle entre deux scènes, le pipeline extrait automatiquement la dernière image de la scène A via Fal.ai, et l’injecte comme image de référence pour la génération de la scène B. Résultat : le personnage ou l’environnement ne “glitche” pas entre les séquences. C’est ce détail technique qui sépare une vidéo IA cohérente d’un collage aléatoire.

Sortie : tous les assets de la vidéo stockés sur Cloudinary, prêts pour l’assemblage.

Le Monteur — il livre la vidéo finale

Entrée : les assets Cloudinary dans l’ordre des scènes.

Action : récupère toutes les scènes, fusionne voix off et vidéo scène par scène via Fal.ai, réordonne les séquences, concatène le tout en une vidéo finale.

Sortie : un email avec le lien de téléchargement direct. Tu télécharges, tu publies.

Aucune intervention sur les tâches de production entre le déclenchement et la livraison.

À quoi ressemble un run réel dans n8n ?

Voilà ce qui se passe concrètement quand tu déclenches une production :

1. Déclencheur — tu cliques sur “Générer vidéo” dans Airtable sur l’idée de contenu souhaitée. Un webhook envoie l’identifiant de l’idée au workflow Producteur dans n8n.

2. Lecture Airtable — le Producteur interroge ta base : il va chercher les données de ta marque, ton audience (ex. : “entrepreneur e-commerce, France, 30-45 ans”), ta charte graphique, les contraintes de format et de durée.

3. Scénarisation — le Scénariste reçoit le brief, appelle le LLM via OpenRouter, génère la structure narrative en JSON : 4 à 8 scènes selon la durée cible, avec le prompt vidéo et le script audio de chaque séquence.

4. Génération en parallèle — le Réalisateur lance la génération scène par scène via Kie (le connecteur vers les modèles vidéo). Chaque scène est générée, sa dernière image extraite par Fal.ai pour servir de référence à la scène suivante. La voix off de chaque scène est générée en parallèle via ElevenLabs. Tous les fichiers sont uploadés sur Cloudinary avec leur numéro de scène.

5. Assemblage — le Monteur récupère les scènes dans l’ordre depuis Cloudinary, fusionne voix + vidéo scène par scène, concatène les séquences, produit la vidéo finale.

6. Livraison — tu reçois un email avec le lien Cloudinary. La vidéo est également enregistrée dans ta table “Contenu Produit” dans Airtable.

Les 5 minutes en détail : déclenchement (10 secondes) + génération des scènes en parallèle (3-4 minutes selon le modèle et le nombre de scènes) + assemblage (30-60 secondes) + réception email (immédiate). Ce que tu fais pendant ce temps : n’importe quoi d’autre.

Si une scène est ratée : le pipeline inclut un système de régénération scène par scène. Tu identifies la séquence problématique, tu la relances seule, le Monteur recompose la vidéo complète en 2 minutes. Tu ne recommences pas depuis zéro.

La stack et ce que ça coûte vraiment

Voilà ce que tu installes, et ce que ça coûte réellement.

| Composant | Outil | Coût approx. / vidéo |

|---|---|---|

| Orchestration | n8n (self-hosted) | — |

| Base de données | Airtable | — |

| LLM scénarisation | GPT-4o-mini via OpenRouter | < 0,01 € |

| Voix off | ElevenLabs | ~ 0,05 € |

| Génération vidéo | Grok via Kie | ~ 0,35 € |

| Assemblage | Fal.ai | ~ 0,02 € |

| Stockage | Cloudinary (version gratuite) | — |

| Total | Pipeline complet | < 0,50 € |

Pour 20 vidéos par mois : moins de 15 € de coûts IA (OpenRouter + ElevenLabs). Fal.ai est quasi-gratuit à ce volume : environ 0,09 $ pour plus de 200 scènes assemblées, mesuré en production réelle.

⚠️ Ces coûts correspondent à l’utilisation de Grok (le modèle vidéo le moins cher) avec GPT-4o-mini pour la scénarisation. Les modèles Sora et Véo coûtent significativement plus (Véo : 55 crédits pour 5 secondes). Les prix des crédits IA peuvent aussi évoluer — traite ces chiffres comme un ordre de grandeur solide, pas comme un contrat.

C’est mathématique. Pas magique.

À comparer avec une production manuelle minimum : 20 vidéos × 20 minutes = 6h40 de ton temps par mois. La comparaison n’a aucun sens à n’importe quel taux horaire.

Les fondations Airtable : paramétrer une fois, produire à l’infini

Le pipeline ne fonctionne pas dans le vide. Sa puissance vient de ce que tu y as configuré en amont dans Airtable.

La base centralise tout : ta marque (nom, valeurs, charte graphique, ton éditorial), tes audiences (chaque profil est une ligne avec ses paramètres spécifiques), tes thématiques (reliées à chaque audience), tes idées de contenu (chaque idée déclenche un projet vidéo complet), les voix disponibles, les structures narratives, les templates de scènes.

Le point clé sur les audiences : si tu crées une version espagnole d’une audience existante, le pipeline sélectionne automatiquement la voix ElevenLabs adaptée à l’espagnol et adapte le script. Tu gères plusieurs marchés et plusieurs langues à partir d’une seule infrastructure — sans retoucher les workflows.

Les cas d’usage sont larges : personal brand, e-commerce avec chaîne de contenu produit, chaîne de niche sur une thématique spécifique, plusieurs chaînes en parallèle sur des marchés différents. Le système s’adapte à ce que tu y mets.

Ce que le pipeline ne fait pas (à lire avant de commencer)

❌ Il ne garantit pas la viralité. Il te donne la cadence de publication pour tester plus vite et apprendre plus vite. Ce qui prend ou ne prend pas dépend de ton contenu et de ton audience — le pipeline ne remplace pas ça.

❌ Le setup prend une après-midi, pas 10 minutes. Installation du serveur n8n, création des credentials (OpenRouter, Kie, ElevenLabs, Cloudinary, Airtable), import des workflows, connexion des nœuds, test de bout en bout. C’est du low-code, pas du no-code : tu manipules des structures JSON, pas des lignes de code, mais tu dois comprendre ce que tu branches.

❌ Les scènes peuvent être imparfaites. D’où le système de régénération scène par scène. L’objectif n’est pas zéro supervision — c’est réduire le temps de production de 45 minutes à 5 minutes de supervision par vidéo.

✅ Ce qu’il fait vraiment : il industrialise les tâches répétitives et sans valeur ajoutée (recherche de visuels, montage, export multi-format, gestion des assets). Il tourne pendant que tu travailles sur ton business. Il ne prend pas de vacances.

Questions fréquentes

Faut-il savoir coder pour monter ce pipeline n8n ?

Non au sens strict. n8n est un outil low-code : tu importes des workflows déjà construits (fichiers JSON fournis dans la formation), tu renseignes tes clés API dans les champs dédiés, et tu connectes les nœuds visuellement. En revanche, “low-code” ne veut pas dire “zéro courbe d’apprentissage” : tu vas manipuler des structures de données JSON, lire des messages d’erreur de nœuds, et comprendre comment les données circulent entre les étapes. Si tu sais naviguer dans un tableur complexe et lire un message d’erreur sans paniquer, tu peux faire ça.

Quel modèle IA vidéo choisir pour commencer : Grok, Kling, Sora ou Véo ?

Commence avec Grok — le moins cher (moins d’un crédit pour une scène de 6 secondes), disponible immédiatement via OpenRouter, idéal pour valider ton pipeline de bout en bout avant d’investir dans des modèles premium. Kling est une alternative avec des séquences légèrement plus longues. Sora et Véo produisent des scènes jusqu’à 15 secondes et intègrent leurs propres voix de qualité (ElevenLabs inutile sur ces modèles), mais coûtent significativement plus. La formation couvre l’installation de chaque modèle via des modules bonus dédiés.

Est-ce que le pipeline peut produire des vidéos en plusieurs langues ?

Oui. ElevenLabs génère des voix de haute qualité dans 29 langues. En changeant la variable “langue” de ton audience dans Airtable, le système sélectionne automatiquement la voix appropriée et adapte le script. Tu peux donc gérer plusieurs marchés (FR, ES, EN, DE…) en parallèle à partir des mêmes thématiques et idées — la diffusion multilingue est intégrée dans l’architecture de base.

Arrête de fabriquer à la main ce qu’une machine peut produire en 5 minutes

La production vidéo manuelle a une limite physique : tu ne peux pas scaler ton temps. Un pipeline n8n, lui, ne connaît pas cette limite.

Le vrai sujet n’est pas “est-ce que je dois automatiser ma production vidéo”. Le vrai sujet, c’est : combien de temps encore tu vas passer à faire à la main ce qu’un système peut produire pendant que tu travailles sur ce qui compte vraiment dans ton business.

Si tu veux éviter de repartir de zéro à la prochaine vidéo — et construire une infrastructure qui tient la cadence sans toi — la formation IA Short Factory est construite exactement pour ça : 4 modules, les workflows prêts à importer, les fondations Airtable documentées, et les coûts IA maîtrisés sous les 15 €/mois.

👉 Construis ta Short Factory — accès immédiat, workflows prêts à brancher.